视频里以“迈克尔乔丹打篮球”为例,当输入“迈克尔乔丹”之后,模型能输出“篮球”等相关的事实性信息,说明模型中某些地方储存了信息

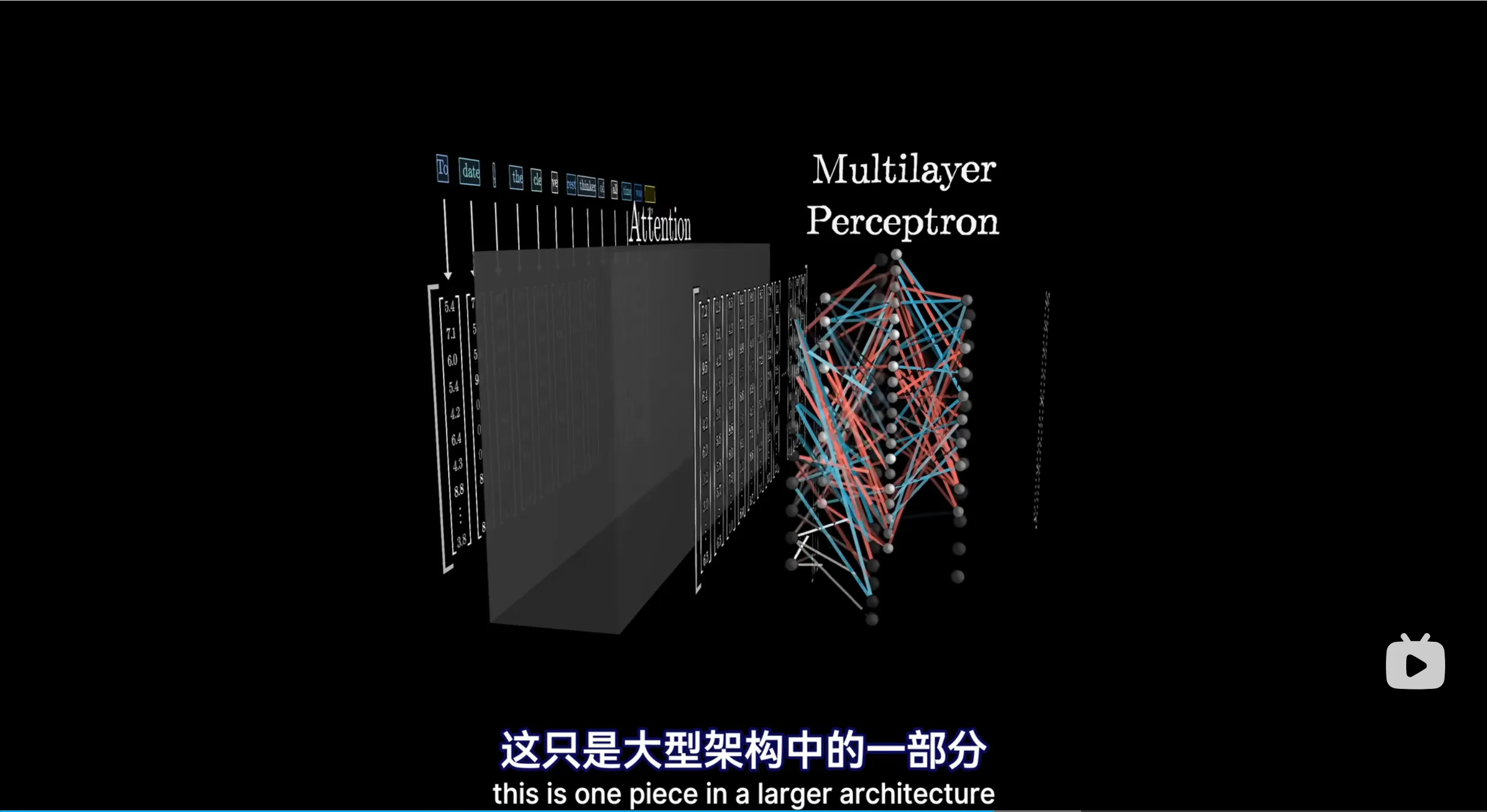

很可能在MLP层中,占了GPT3 1/3的参数

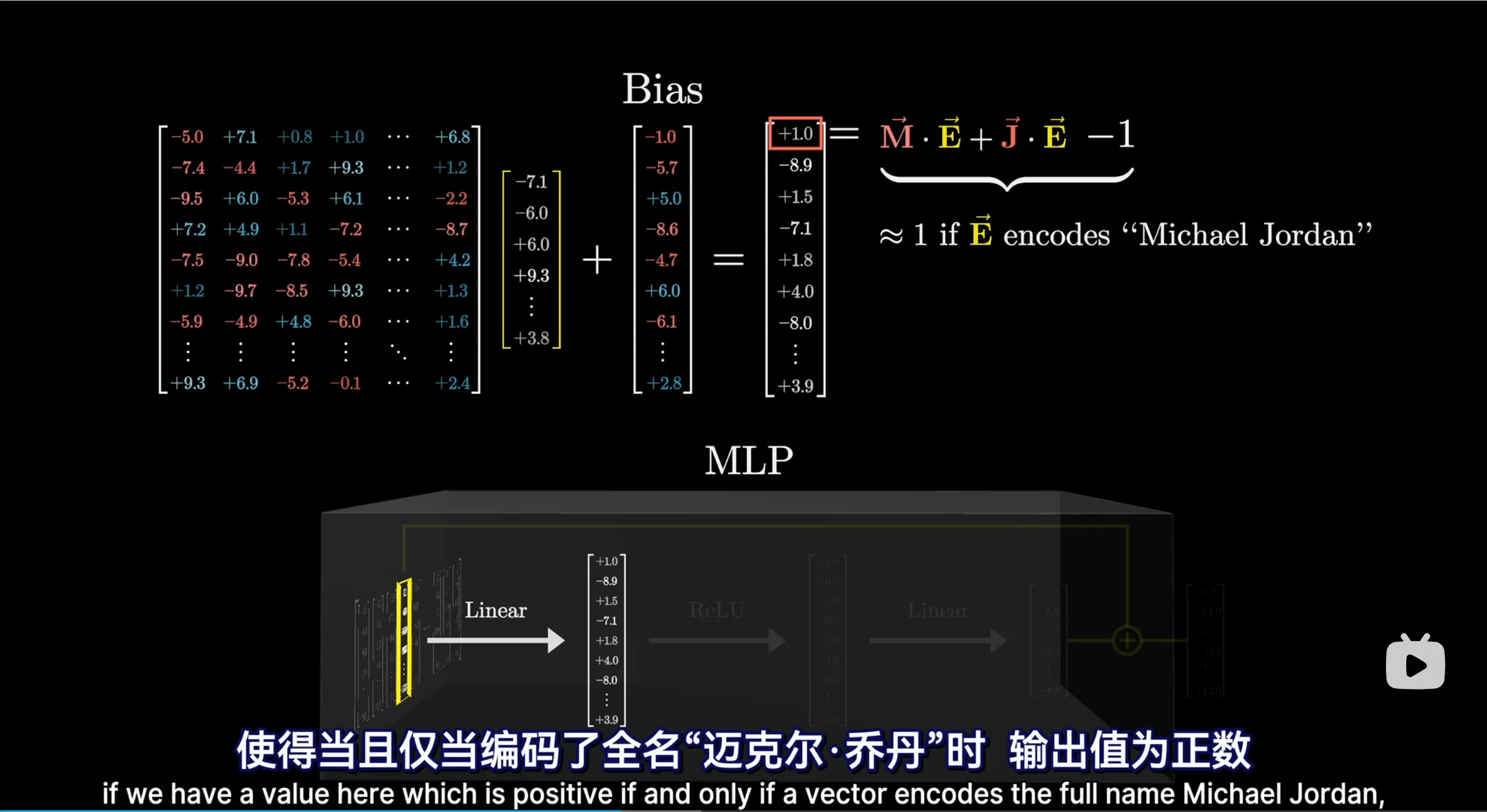

视频的例子里,输入向量先与一个升维矩阵相乘。可以理解成,这个句子的行代表嵌入空间的一系列信息,乘积衡量了信息和输入向量的匹配度(bias决定触发之后ReLU的阈值)相当于对输入向量问各类问题

然后再通过一个降阶矩阵,得到问题的答案向量,这个向量再与输入向量叠加,得到了编码了事实的信息

这其实就是之前所说的3B1B 多层感知器

是一个三层的MLP,第一层输入,第三层输出,中间层更高阶一些

视频里还提到了叠加super position的概念,可能是模型难以解释的原因

一个n维的空间有n个正交基,但是如果放宽正交的性质,比如把垂直角度放到89-91°,可能放进的“正交”向量数量随维度以指数级别增长。对应到嵌入空间里,大大增加了方向对应的词义,这可能就部分解释了模型参数增加带来的质变

这样的话,在MLP的得到的高阶向量的每一个神经元,可能不一一对应着某个特定的信息。某个信息可能表现为所有神经元的一个线性组合

Johnson-Lindenstrauss Lemma